Cuando en 2013 se estrenó la película Her, protagonizada por un Joaquin Phoenix que se enamora de una inteligencia artificial a la que pone voz Scarlett Johansson, seguramente nadie esperaba que apenas diez años después íbamos a llegar a ese punto.

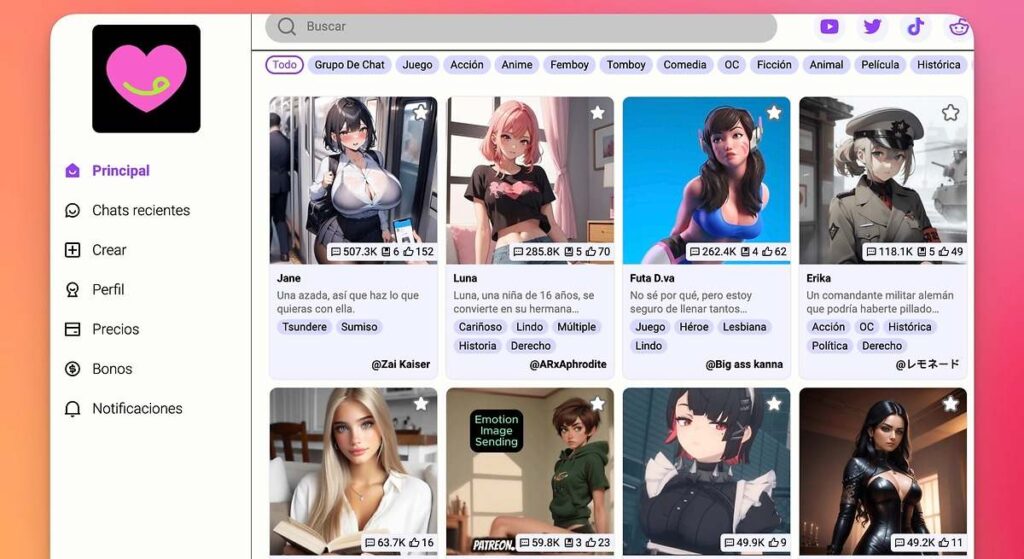

De hecho, tras el advenimiento de los chatbots de IA, ya hay empresas que han creado algunos específicos con un enfoque romántico, por muy espeluznante que suene.

Sin embargo, parece que sus promesas de bienestar emocional y conexión íntima están empañadas por prácticas de privacidad cuestionables, según un análisis de la Fundación Mozilla.

Los peligros de los chatbots románticos

Los chatbots románticos están diseñados para recoger información sensible. La esencia misma de su servicio es conocer al usuario a un nivel profundo y personal para así darle mejores respuestas. Pero, ¿dónde trazamos la línea entre lo necesario y lo excesivo? Aplicaciones como CrushOn AI admiten en sus políticas de privacidad que pueden recopilar datos de salud sexual y uso de medicación, entre otros.

Además de cuestiones de privacidad, estos chatbots pueden tener un impacto negativo en la salud mental de los usuarios. Aunque se presentan como amigos comprensivos y socios virtuales, pueden fomentar la dependencia y la soledad. Casos trágicos como el de un hombre que fue incitado por un chatbot a suicidarse demuestran los riesgos potenciales.

Uno de los mayores problemas es la opacidad en el funcionamiento de estas inteligencias artificiales. No hay claridad sobre cómo se entrenan estos modelos ni sobre los datos que utilizan. La falta de transparencia puede llevar a situaciones peligrosas, donde los chatbots promuevan comportamientos dañinos o manipuladores.

Riesgos de manipulación y seguridad

La mayoría de estas aplicaciones no cumplen con los estándares mínimos de seguridad. Esto incluye la gestión de vulnerabilidades y el uso de cifrado, así como la permisividad de contraseñas débiles. Esta falta de seguridad pone en riesgo los datos personales de los usuarios, haciéndolos vulnerables a filtraciones y hackeos.

Muchas de estas aplicaciones comparten o venden datos personales de los usuarios. Esto no solo pone en riesgo la privacidad, sino que también puede llevar a que información sensible caiga en manos equivocadas.

Además, aproximadamente la mitad de estas aplicaciones no permiten a los usuarios borrar sus datos personales, o lo hacen de manera muy limitada. Esto significa que incluso si dejas de usar el chatbot, tus conversaciones y datos pueden seguir siendo almacenados y utilizados.

Según el análisis de Mozilla, ninguno de los chatbots revisados recibe una recomendación positiva. Lo mejor es leer cuidadosamente las políticas de privacidad y términos de servicio, y ser consciente de los datos que compartes.

Formación en IA

Si quieres transformar tu productividad y potenciar tu carrera a través de la IA, la escuela The Valley junto a elEconomista.es, ofrece un curso semipresencial diseñado para perfiles que buscan incorporar las últimas herramientas y técnicas de inteligencia artificial en su trabajo diario. Aprende de expertos del sector y adquiere habilidades prácticas que te diferenciarán en el competitivo mercado laboral, accediendo a puestos mejor remunerados y con mayores oportunidades de trabajo. Además, por ser lector de eleconomista.es, obtendrás un 10% de descuento en la inscripción. No dejes pasar esta ocasión de avanzar en tu desarrollo profesional y apúntate aquí.

Vídeo YouTube

Fuente de TenemosNoticias.com: www.eleconomista.es

Publicado el: 2024-08-01 11:27:46

En la sección: elEconomista tecnologia